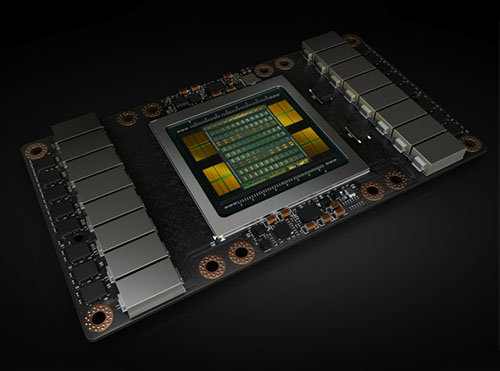

产品详情

V100 SXM2

适用范围

GPU高性能计算

深度学习、科学计算

同时运用GPU与CPU服务器的数据中心

产品特性

人工智能训练

Tesla V100 拥有 640 个 Tensor 内核,是世界上*一个突破 100 万亿次 (TFLOPS) 深度学习性能障碍的 GPU。新一代 NVIDIA NVLink™ 以高达 300 GB/s 的速度连接多个 V100 GPU,在全球打造出功能极其强大的计算服务器。现在,在之前的系统中需要消耗数周计算资源的人工智能模型在几天内就可以完成训练。随着训练时间的大幅缩短,人工智能现在可以解决各类新型问题。

人工智能推理

Tesla V100 就是为了在现有的超大规模服务器机架上提供更高的性能。由于将人工智能作为核心,Tesla V100 GPU 可提供比 CPU 服务器高 30 倍的推理性能。这种吞吐量和效率的大幅提升将使人工智能服务的扩展变成现实。

高性能计算

Tesla V100 的设计能够融合人工智能和高性能计算。它为高性能计算系统提供了一个平台,在用于科学模拟的计算机科学和用于在数据中发现见解的数据科学方面表现优异。通过在一个统一架构内搭配使用 NVIDIA CUDA® 内核和 Tensor 内核,配备 Tesla V100 GPU 的单台服务器可以取代数百台仅配备通用 CPU 的服务器来处理传统的高性能计算和人工智能工作负载。现在,每位研究人员和工程师都可以负担得起使用人工智能超级计算机处理*具挑战性工作的做法。

产品参数

产品型号 | V100-SXM2 |

GPU芯片代号 | GV100 |

CUDA核心数量 | 5120 |

Tensor核心数量 | 640 |

CUDA核心频率 | 1455MHz |

显存容量 | 32GB/16GB |

显存带宽 | 900GB/s |

显存类型 | HBM2 |

半精度性能(峰值) | 30TFLOFPS |

单精计算性能(峰值) | 15TFLOFPS |

双精计算性能(峰值) | 7.5TFLOFPS |

深度学习性能(峰值) | 120TFLOPS |

互联带宽(双向) | 300GB/s |

功耗 | 300W |

资源下载

V100产品白皮书V1.0

下载